شرکت OpenAI، سازنده ChatGPT، امروز از جدیدترین ابزار خود به نام Aardvark (آردوارک) رونمایی کرد. این ابزار یک «محقق امنیتی عامل» (Agentic Security Researcher) است که از قدرت مدل پیشرفته GPT-5 بهره میبرد. هدف اصلی آردوارک، ایجاد تحول در امنیت نرمافزار است؛ این عامل هوش مصنوعی مستقل طراحی شده تا به توسعهدهندگان و تیمهای امنیتی در کشف، تحلیل و رفع آسیبپذیریهای امنیتی در مقیاس بزرگ کمک کند.

امنیت نرمافزار یکی از حیاتیترین و در عین حال چالشبرانگیزترین مرزهای فناوری است. در حالی که مدافعان (تیمهای امنیتی) برای یافتن و رفع آسیبپذیریها تلاش میکنند، Aardvark OpenAI آمده است تا این تعادل را به نفع آنها تغییر دهد. این ابزار هماکنون در نسخه بتای خصوصی در دسترس قرار گرفته است.

آردوارک OpenAI چگونه کار میکند؟

برخلاف ابزارهای سنتی تحلیل برنامه مانند Fuzzing، آردوارک OpenAI از استدلال مبتنی بر مدل زبانی بزرگ (LLM) و استفاده از ابزار برای درک رفتار کد و شناسایی آسیبپذیریها بهره میبرد. به عبارت سادهتر، آردوارک مانند یک محقق امنیتی انسانی کدها را میخواند، تحلیل میکند، تست مینویسد و اجرا میکند.

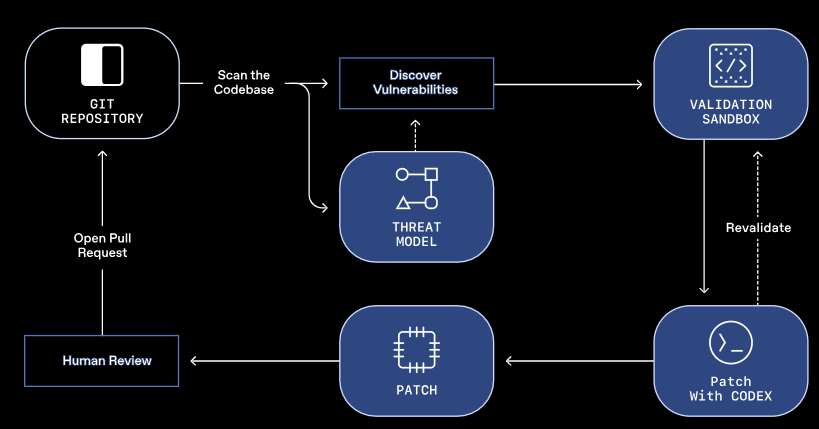

Aardvark به طور مداوم مخازن سورس کد (Source Code Repositories) را تجزیه و تحلیل میکند تا آسیبپذیریها را شناسایی، قابلیت بهرهبرداری (Exploitability) آنها را ارزیابی، شدت آنها را اولویتبندی و در نهایت، وصلههای (Patches) هدفمند پیشنهاد دهد. این فرآیند در یک خط لوله چند مرحلهای انجام میشود:

- تحلیل (Analysis): ابتدا کل مخزن کد را تحلیل میکند تا یک «مدل تهدید» (Threat Model) بر اساس اهداف امنیتی پروژه تولید کند.

- اسکن کامیتها (Commit Scanning): با هر کامیت (تغییر جدید در کد)، آسیبپذیریها را با بررسی تغییرات نسبت به کل مخزن و مدل تهدید اسکن میکند.

- اعتبارسنجی (Validation): پس از شناسایی یک آسیبپذیری بالقوه، Aardvark تلاش میکند تا در یک محیط ایزوله و امن (Sandbox) آن را اجرا کند تا از واقعی بودن و قابل بهرهبرداری بودن آن اطمینان حاصل کند.

- ارائه پچ (Patching): آردوارک با OpenAI Codex یکپارچه شده است تا به رفع آسیبپذیریهایی که پیدا میکند کمک کند. این ابزار یک پچ تولید شده توسط Codex را به هر یافته پیوست میکند تا توسط انسان بررسی و با یک کلیک اعمال شود.

اهمیت Aardvark برای آینده امنیت نرمافزار

نرمافزار اکنون ستون فقرات هر صنعتی است و این بدان معناست که آسیبپذیریهای نرمافزاری یک خطر سیستمیک برای کسبوکارها، زیرساختها و جامعه محسوب میشوند. (تنها در سال ۲۰۲۴ بیش از ۴۰,۰۰۰ آسیبپذیری CVE گزارش شده است).

آردوارک OpenAI یک مدل جدید «مدافع-محور» (Defender-First) ارائه میدهد. این ابزار به عنوان یک همکار با تیمهای توسعه کار میکند و با تکامل کد، حفاظت مستمر را ارائه میدهد.

تأثیر واقعی و کمک به پروژههای متنباز (Open Source)

Aardvark ماههاست که در حال اجرا بر روی کدهای داخلی OpenAI و شرکای آلفا بوده است. در تستهای بنچمارک، این ابزار توانسته ۹۲ درصد از آسیبپذیریهای شناختهشده و تزریقشده مصنوعی را شناسایی کند.

علاوه بر این، Aardvark بر روی پروژههای متنباز نیز اعمال شده و تاکنون موفق به کشف آسیبپذیریهای متعددی شده که ۱۰ مورد از آنها شناسه رسمی (CVE) دریافت کردهاند. OpenAI قصد دارد اسکن رایگان (pro-bono) را به مخازن متنباز غیرتجاری منتخب ارائه دهد تا به امنیت اکوسیستم نرمافزار متنباز کمک کند.

وضعیت فعلی: نسخه بتای خصوصی

آردوارک OpenAI هماکنون در یک نسخه بتای خصوصی (Private Beta) راهاندازی شده است. OpenAI از شرکای منتخب دعوت کرده تا به این بتا بپیوندند و به پالایش دقت تشخیص، گردش کار اعتبارسنجی و تجربه گزارشدهی کمک کنند. سازمانها و پروژههای متنبازی که علاقهمند به پیوستن هستند، میتوانند برای دسترسی درخواست دهند.